プルリクエスト(PR)を作成してから実際にメインブランチへマージされるまでのリードタイムは、開発チーム全体の生産性(タイムパフォーマンス)を決定づける最大の要因の一つです。いかに高速に質の高いコードを実装したとしても、シニアエンジニアのレビュー待ちによって数時間、あるいは数日のボトルネックが発生する現場は決して珍しくありません。この待ち時間を極限まで圧縮しつつ、コードベースの健全性を維持するための一手として、LLMを活用した「AIによるコードレビューの完全自動化と自動マージ」の運用基盤を実務レベルで構築する手法が注目を集めています。今回は、チームのレビュー負荷を下げるだけでなく、ルールの陳腐化を防ぐ自律的なAI運用サイクルについて、アーキテクチャ設計の観点から深く掘り下げて考察します。

AIレビュー基盤を実運用に乗せるための設計要件

単にGitHub Actions上で変更差分(diff)をLLMに投げ、コメントを返させるだけのシステムは、初期設定こそ容易ですが実務ではすぐに破綻します。誤検知(False Positive)の多発によるノイズ疲労や、システム構成変更に伴うルールの陳腐化が避けられないからです。実用的な自動マージ(Auto-merge)を実現するためには、「AIが判断する領域」と「人間が最終意思決定を持つ領域」を明確に切り離し、AIが常に最新のドメイン知識を元に判定を行える仕組みを構築する必要があります。

システム導入のメリットと技術的優位性

AIレビュー基盤を高度に運用する最大のメリットは、人間のエンジニアが「設計の妥当性」や「ビジネス要件との整合性」といった高次元の意思決定にリソースを集中できる点にあります。コーディング規約の遵守、N+1問題の検知、エラーハンドリングの漏れといった静的なパターンマッチングに近い部分はAIが即座にフィードバックを返し、問題がなければそのままApproveします。これにより、開発者はコンテキストスイッチを起こすことなく、実装からデプロイまでのサイクルを回すことが可能になります。

また、複数のペルソナ(例えば「シニアGoエンジニア」「シニアアーキテクト」「データベース専門家」など)を持たせたマルチエージェント構造を採用することで、単一のLLMでは見落としがちな多角的な視点でのレビューが可能となり、人間による属人的なレビューよりも一貫性のあるコード品質検査を実現できる技術的優位性があります。

実務現場におけるデメリットと注意点

一方で、実運用にあたってはいくつかの越えるべきハードルが存在します。最大の懸念事項は、コード品質の担保をAIだけに依存できない点です。AIの幻覚(ハルシネーション)や未知のエッジケースを見逃すリスクに備え、包括的なE2Eテストや強力なLintツールを統合した堅牢なCIパイプラインの構築が絶対的な前提条件となります。CIが通らないコードはAIがどう判断しようと弾かれる、というフェイルセーフ設計が必須です。

また、「リジェクトの基準」を適切にコントロールしなければ、開発者の開発体験(DX)を著しく損ないます。マージをブロックするのは「そのまま本番環境に出せば障害に直結する致命的な問題(セキュリティ脆弱性やデータ不整合など)」に限定し、それ以外の手法やリファクタリングの提案はSuggestion(非ブロックの改善提案)に留めるという厳格なポリシー運用が求められます。さらに、一度定義したレビュー規約を自動でメンテナンスし続ける仕組み(分析・改善エージェントの定期実行など)を用意しない限り、急速に変化するコードベースにAIが追従できなくなる点には細心の注意が必要です。

コードレビュー手法の比較分析

従来のレビュープロセスと、AIを活用したアプローチの違いを整理します。特にルール更新の自律性が実運用における大きな分水嶺となります。

| 比較項目 | 従来の手動レビュー | 単一LLMによる基本レビュー | 自律改善型マルチエージェント基盤 |

|---|---|---|---|

| リードタイム | 長(数時間〜数日) | 短(数分) | 極めて短(即時Auto-merge可) |

| ルール鮮度の維持 | ドキュメントの手動更新が必要 | プロンプトの手動更新が必要 | 実行履歴から自動生成・パージ |

| レビューの安定性 | レビュアーのスキルに依存 | プロンプトの質とモデル精度に依存 | 複数専門家ペルソナの統合で安定 |

| 導入コスト・運用負荷 | 初期低、長期運用負荷高 | 初期中、長期運用負荷高 | 初期高(基盤構築)、長期運用負荷低 |

ドメイン知識と危険度を定義する設定例

AIによる自動マージを安全に稼働させるためには、コードベース内のどの領域が致命的であるかをAIに事前学習させる設定ファイル(コンテキスト)が不可欠です。以下は、領域別の危険度マップを構造化し、AIエージェントに読み込ませるためのYAML構成のサンプルです。

# ai-review-config.yaml

# レビューシステムが参照する危険度マップとドメインルールの定義

repository_risk_map:

critical:

paths:

- "internal/domain/payment/**"

- "internal/domain/auth/**"

policy: "Auto-merge禁止。必ず指定された人間のシニアエンジニアにエスカレーションすること。"

high:

paths:

- "db/migrations/**"

- "infra/terraform/**"

policy: "Auto-merge禁止。破壊的変更の有無を分析し、人間によるPlan確認を要求すること。"

medium:

paths:

- "internal/usecase/**"

- "pkg/shared/**"

policy: "E2Eテスト及び静的解析がPassし、致命的なアンチパターンがなければApproveを許可。"

low:

paths:

- "docs/**"

- "tools/scripts/**"

policy: "即時Auto-merge許可。Suggestionは非ブロックでコメントとして残す。"

domain_knowledge:

external_api:

- "決済API v2は稀に503を返すため、必ずエクスポネンシャルバックオフによるリトライ処理を実装すること。"

このように、システムに対する変更の「不可逆性」と「ビジネスインパクト」をAIが機械的に判別できるメタデータを用意することが、安全な運用において極めて重要です。

専門家としての最終見解

コードレビューの大部分をAIに委譲するアプローチは、単なる省力化にとどまらず、「エンジニアリング組織のカルチャー変革」をもたらします。日常的なコーディングの指摘から解放されることで、チームはアーキテクチャの妥当性、非機能要件の設計、そしてユーザーに提供するビジネス価値そのものに対する議論に多くの時間を割けるようになります。

今後、ソフトウェア開発におけるAIの役割は、人間のアシスタントから、ドメイン規約の番人であり自律的なペースメーカーへと進化していくでしょう。我々シニアエンジニアに求められるのは、細かなコードの粗探しをすることではなく、「AIが正しく機能するためのルール設計(コンテキストエンジニアリング)」と、「万が一システムが破綻した際のフェイルセーフを担保するアーキテクチャの構築」へとシフトしています。AIを開発フローの中心に据える際は、まずは人間による監視下でテスト運用を行い、計測と改善のループを確立した上で、段階的に権限を委譲していくアプローチを強く推奨します。

参考記事: 全PRの83%をAIレビューだけでマージできるようにした

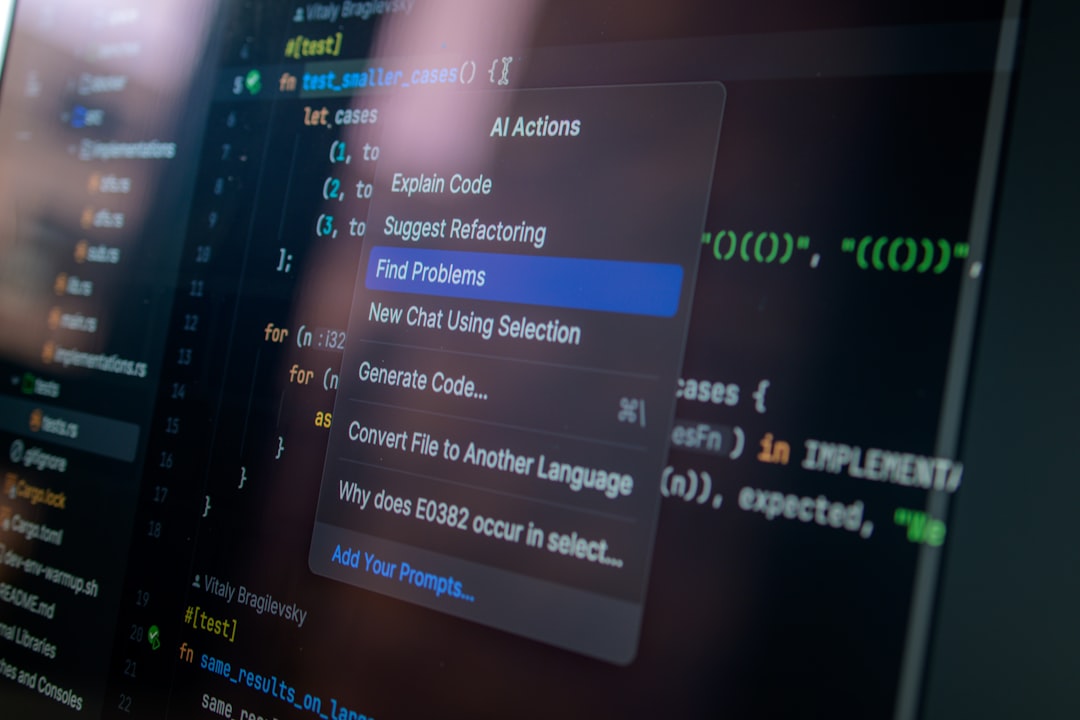

Photo by Daniil Komov on Unsplash